Perlumbaan dalam membangunkan model AI, terutamanya model bahasa besar (large language model), dapat dilihat dengan pengenalan kepada pelbagai model baharu seperti GPT-4.5 (OpenAI), Gemini 1.5 (Google DeepMind), Llama 3.3 (Meta), DeepSeek V3 (DeepSeek), Claude 3 Opus (Anthropic) dan pelbagai lagi. Model-model ini kebiasaannya menjanjikan tahap ketepatan yang tinggi dengan reka bentuk arkitektur yang lebih kompleks. Walau bagaimanapun, model AI tidak lari dari masalah halusinasi AI yang menjadi cabaran semasa proses pembangunannya.

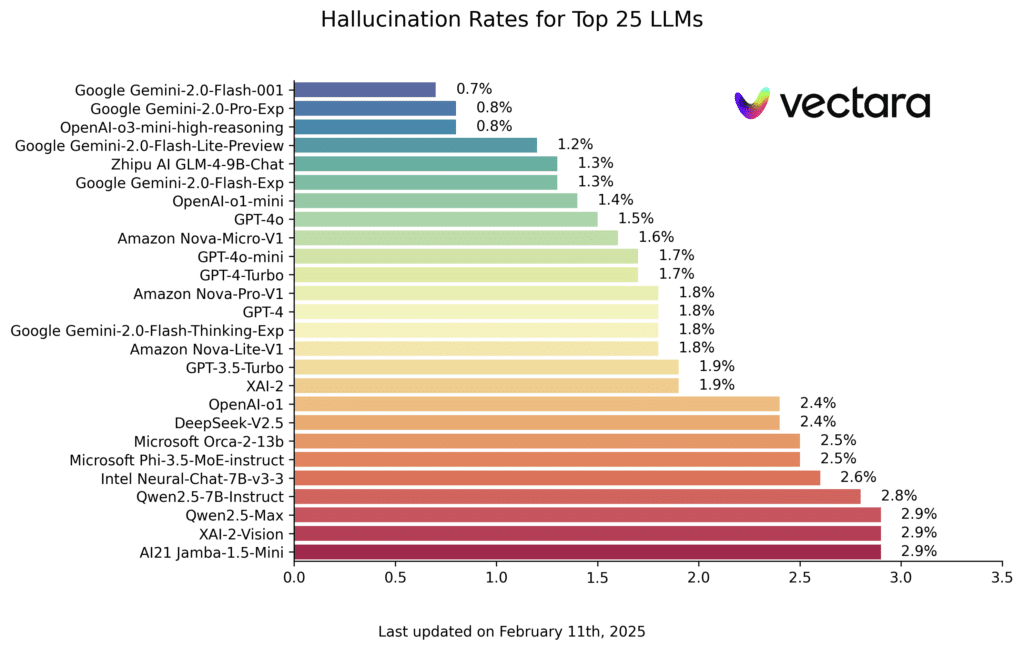

Halusinasi AI berlaku apabila model AI mula menjana maklumat palsu atau mengelirukan yang kelihatan munasabah tetapi tidak berdasarkan fakta sebenar. Satu penilaian halusinasi telah dijalankan oleh Hughes, S., Bae, M., & Li, M. (2023) terhadap pelbagai model bahasa besar AI. Keputusan penilaian tersebut adalah seperti dalam rajah di bawah.

Kini, halusinasi AI merupakan cabaran besar dalam pembangunan model bahasa besar kerana ia boleh mengelirukan pengguna, terutamanya apabila AI digunakan untuk menjana teks dalam konteks yang memerlukan ketepatan tinggi seperti keagamaan, perubatan, undang-undang, dan berita rasmi. Pembangun model bahasa besar AI cuba mengurangkan halusinasi dengan menambah baik data latihan, membuat penyesuaian lanjutan (fine-tuning), dan menggabungkan model AI dengan semakan fakta masa nyata.

Sebagai pengguna awam, terdapat beberapa langkah yang boleh diambil untuk memastikan maklumat yang diperoleh adalah tepat dan berkualiti. Pertama, semak tarikh sesuatu model bahasa besar AI dibangunkan seperti yang ditunjukkan dalam jadual di bawah:

| Model | Tarikh Model Dibangunkan |

| ChatGPT (GPT-4.5) | October 2023 |

| Claude (Claude 3) | August 2023 |

| Gemini (Gemini 1.5) | July 2023 |

| DeepSeek (DeepSeek-V2) | May 2024 |

| Llama 3.3 (Meta) | December 2023 |

* Maklumat ini dijana melalui ChatGPT melalui prompt berikut: “please provide training data cut-off date for these models: ChatGPT (GPT-4.5), Claude (Claude 3), Gemini (Gemini 1.5), DeepSeek (DeepSeek-V2), Llama 3.3 (Meta)”

Selain itu, pengguna boleh membuat semakan teks atau fakta yang dijana melalui sumber luaran seperti carian Google, laman web yang dipercayai, buku, dan artikel yang telah diterbitkan. Untuk tujuan penulisan saintifik akademik, semakan wajar dibuat melalui artikel penyelidikan yang diterbitkan secara rasmi seperti di perpustakaan digital IEEE Explore, ACM Computing, Science Direct, Springer Link, dan lain-lain. Semakan silang (cross-check) dengan model AI lain juga boleh dilakukan. Jika satu model AI memberikan jawapan yang tidak pasti, pengguna boleh bertanya kepada model lain seperti Claude atau Gemini untuk mengesahkan dan membandingkan hasilnya.

Selain itu, penting untuk menulis arahan (prompts) yang tepat dan jelas mengenai maklumat yang diperlukan. Contohnya, daripada meminta “Tell me about the latest iPhone,” pengguna boleh bertanya, “What are the specifications of the latest iPhone 15 Pro, and what are the major differences from iPhone 14 Pro?”. Pengguna juga boleh meminta AI untuk memetik sumber atau memberikan jawapan “I don’t know” jika maklumat tidak dapat dipastikan. Akhir sekali, penggunaan AI sebaiknya dijadikan sebagai sumber sekunder dan bukannya sumber utama. Ini bermakna AI boleh digunakan untuk menyokong penyelidikan atau penulisan rasmi tetapi tidak seharusnya dijadikan satu-satunya rujukan yang muktamad.

Perlu ditegaskan bahawa AI tidak mencipta pengetahuan baharu. Model AI hanya mensintesis maklumat sedia ada dan menghasilkan maklumat baharu untuk dijadikan sumber sekunder. Oleh sebab itu, salah satu model AI dipanggil Generative Pre-trained Transformer (GPT) yang membawa maksud tersendiri. Perkataan “Generative” merujuk kepada keupayaan untuk mencipta atau menghasilkan sesuatu yang baharu, “Pre-trained” merujuk kepada model AI yang telah melalui fasa latihan awal menggunakan data yang besar sebelum digunakan untuk menjana maklum balas, manakala “Transformer” adalah teknik seni bina model AI yang digunakan untuk memproses jujukan atau turutan data.

Oleh hal yang demikian, model AI perlu digunakan secara berhati-hati, berhemah, dan penuh beretika. Kepada para pelajar, halusinasi AI boleh dikesan oleh pensyarah atau penyelia yang arif dalam bidang masing-masing kerana mereka telah terlatih dengan fakta dan data yang berkaitan.

Oleh Dr. Mohd Syahid Mohd Anuar dan Prof. Madya Ts. Dr. Mohd Naz’ri Mahrin, Fakulti Kecerdasan Buatan, Universiti Teknologi Malaysia